2月16日早上,王祚的手机里收到了一条公众号推送,文章标题直白且不加掩饰——“现实,不存在了。”

这句看似从科幻小说《三体》中借鉴来的标题吸引了王祚,出于好奇,他打开了这篇推文。文章中讲述的是美国开放人工智能研究中心(OpenAI)推出的视频生成模型sora,它使用Transformer架构,可根据文本指令创建现实且富有想象力的场景,生成多种风格、不同画幅、最长60秒的高清视频。

继推出大语言模型ChatGPT后,OpenAI又进军了视频生成领域,虽然发布的视频只是预览版本,但其视觉效果已然令人咋舌。

“Sora的视觉效果让我十分惊讶。”王祚对新京报记者说道。他目前就读于中国传媒大学,是数字媒体艺术专业的硕士研究生,还对人工智能绘画进行过广泛的研究。王祚补充道,Sora生成的视频整体相对舒适,构图色彩也都在一定程度上满足了当下的需求,“专业师生的整体评价也都是以夸赞为主。”

惊讶于人工智能技术日新月异的同时,外界的担忧也随之到来。OpenAI对Sora的期许是“世界模拟器”,在模拟世界的过程中,人工智能生成视频似乎在进一步模糊现实世界本就脆弱的真假界限,推动“深度伪造”(deepfake)不断涌现,正如最开始吸引王祚的那篇推文所发出的感叹,现实是否就此不复存在?

向前一大步

Sora的出现很快在王祚的同学和老师间引发了讨论,从视觉效果到背后技术,以及人工智能可能对数字媒体专业产生的影响。

根据OpenAI的介绍,Sora能够生成包含多个角色、特定运动类型,精确主题以及背景细节的复杂场景,它不仅了解用户在文本提示中的要求,还能理解所述内容在物理世界中的存在方式。

Sora并不是同类产品中的第一个,谷歌、Meta等公司也都有类似的技术,但OpenAI展示出的几个高质量预告视频,让不少观察者惊诧不已。在王祚看来,Sora的整体性逻辑以及视觉观感其实都已经远远超越之前一些所谓的人工智能生成视频的工具,“从这一点来说,Sora取得了飞跃式的进步。”

Sora生成的视频截图。图/OpenAI官网

从定义而言,人工智能是研究、开发用于模拟、延伸和扩展人的智能的理论、方法、技术及应用系统的一门新的技术科学。从这个词被创造出来到20世纪70年代,出现了至今都在使用的编程语言和探索机器人概念的书籍和电影,人工智能几乎成为主流概念。

但在打破人工智能最初的迷雾后,人们也看到了堆积如山的障碍。美国密歇根州立大学丹佛分校计算机科学系主任史蒂夫·比蒂(Steve Beaty)对新京报记者指出,从本质上讲,当时的人工智能的发展主要受到计算机硬件能力的限制。

计算机无法存储足够的信息,也无法以足够快的速度处理信息。麦卡锡的博士生汉斯·莫拉维克(Hans moravec)当年沮丧地说道,“计算机的性能弱了数百万倍,无法展现智能。”随着耐心的减少,资金也随之减少,人工智能研究工作在十年间缓慢推进。1974年到20世纪80年代初期这段时间,被科学新闻网站“livescience”称为“人工智能的第一个寒冬”。

直到20世纪80年代,人工智能研究再次被点燃。首先是算法工具的扩展,“深度学习”技术得以推广,允许计算机利用经验进行学习,以及模拟人类专家决策过程的专家系统被引入。其次,资金也在进一步增加,作为第五代计算机项目的一部分,日本**大力资助了专家系统和其他与人工智能相关的研究,目的是彻底改变计算机处理,实现逻辑编程和改进人工智能。

不幸的是,大多数野心勃勃的目标都没有实现,随后人工智能也淡出了人们的视线,迎来了行业的第二个寒冬。

尽管在此期间缺乏一定资金,但人工智能在上世纪90年代以及21世纪初取得了一些令人印象深刻的进步。1997年,国际象棋世界冠军加里·卡斯帕罗夫(Gary Kasparov)被计算机程序“深蓝”(Deep Blue)击败。同年,美国声龙公司(Dragon Systems)开发的语音识别软件在Windows上得以实现。

事实上,人类在编写人工智能代码上并没有变得更聪明,只是以前阻碍发展的计算机存储问题已经不再是一个问题。伴随着研究兴趣和资金再次激增,人类的生活进入了“大数据时代”,这使得人工智能取得了更大的进展。

“背后的硬件能力终于赶了上来,似乎在突然之间,人工智能开辟了广阔的视野,人类可以将其应用于文字、音频以及制作图像逼真的视频。”比蒂说道,2023年以及2024年是人工智能技术从理论进入实践的年份,从只有学者使用高功率机器才能完成相应技术到几乎任何人只要拥有一部连接网络的电脑,就可以制作各种各样的图像、音频与视频。

从真实到虚假

在人们当下的生活里,人工智能似乎无处不在。

从英国曼彻斯特大学的克里斯托弗·斯特雷奇(Christopher Strachey)编写西洋跳棋程序到今天,人工智能已经被用于帮助疫苗进行RNA测序和人类语言建模。自2023年以来,以ChatGPT聊天机器人程序为代表的生成式人工智能更是引发全球关注。科技网站“BuiltIn”指出,人工智能正以前所未有的方式重新占据舞台的中心,而且它没有很快让出聚光灯的打算。

“我们在网上做的任何事情都离不开人工智能。”哈蒙德说道,搜索引擎上会有人工智能组件预测你想要寻找什么,提供信息、产品或进行推荐的平台背后都有人工智能的痕迹。语音识别以及面部识别也都与人工智能有关。

在一系列引人注目的人工智能应用涌现的刺激下,美国皮尤研究中心邀请305名研究人员、技术创新者、商业领袖以及学者做了一份调查,想看看业内专家对数字化未来的期许。

调查发现未来的确有许多美好的期待,他们期望人工智能会在医疗和教育方面有显著改善,在环境可持续性、气候行动方面取得进展。届时,人们戴上智能眼镜和耳机与周围的人、事物保持联系。

OpenAI将发布视频生成模型Sora。图/IC photo

值得注意的是,与此同时,他们也看到了人工智能会出错的地方。专家对数字技术似乎正在以不可阻挡的速度和范围发展而感到担忧,担心数字系统可能会继续受到经济上的利润激励和**上的权力激励,这可能会加剧不平等、损害**制度,侵犯个人隐私。人工智能还会导致深度伪造,被用于生成虚假信息来欺骗大众。

技术不会止步于此。在Sora出现后,加利福尼亚大学伯克利分校信息学院副院长法里德表示,没有理由相信文本到视频的技术不会继续快速发展,这将使公众越来越接近一个难以区分真假的时代。这项技术如果与人工智能语音克隆(AI-powered voice cloning)相结合,可能会开辟一个全新的前沿,创造出深度伪造内容。

尤其在2024年,人工智能导致的深度伪造问题更为突出。今年年初,世界经济论坛发布了《2024年全球风险报告》,其中将人工智能产生的错误信息和虚假信息列为2024年世界面临的最重大风险之一。

不幸的是,人们担心的事情正在一步步变成现实。不久前,模拟美国总统拜登声音的机器人电话打到了新罕布什尔州初选选民的手机上,由人工智能生成的美国歌手泰勒·斯威夫特带货广告也在社交媒体上大肆传播。

“简而言之,我们现在很难知道该相信什么。”比蒂说道,人们在10年前至少还相信视频,现在虚假视频也随处可见。虽然新科技让人们更难识别虚假信息,但也并非完全不可能。公众仍需依赖常识找到多个信源,面对海量信息学会慢下来静待发展。最后,问题根源中也潜藏着解决办法,公众也应该学会用人工智能应对人工智能。

落后的监管

尽管人工智能行业在近些年蓬勃发展,但出于对其潜在风险的担忧,业内开始出现要求暂缓脚步的声音。

值得一提的是2023年3月份,图灵奖得主约书亚·本吉奥、加州大学伯克利分校计算机科学教授斯图尔特·罗素、企业家埃隆·马斯克等人联名发表公开信,呼吁暂停巨型人工智能实验。罗素曾在接受新京报采访时表示,他们的目的是利用这段时间制定和落实人工智能的安全标准,称要像监管核能一样监管强大的人工智能。

从后续的事态发展来看,这封公开信起到了一定的效果。8个月后,首届全球人工智能安全峰会在英国布莱切利庄园召开,全球28个国家和欧盟签署了《布莱切利宣言》,这是全球第一份针对人工智能这一快速新兴技术的国际性声明。随后,包括美国、英国在内的18个国家签署并公布《安全人工智能系统开发指南》,保护公众数据不被滥用。

当地时间2023年11月1日,首届全球人工智能安全峰会在英国布莱切利庄园召开,全球科技公司的高管和**官员等近百名代表出席。图/IC photo

2023年末,历经马拉松式谈判,欧洲议会、欧盟成员国和欧盟委员会三方就《人工智能法案》达成协议,该法案将成为全球首部人工智能领域的全面监管法规,其中内容包括将严格禁止“对人类安全造成不可接受风险的人工智能系统”,包括有目的地操纵技术、利用人性弱点或根据行为、社会地位和个人特征等进行评价的系统等。

据新华社报道,为规范生成式人工智能的应用,中国已发布《互联网信息服务深度合成管理规定》与《生成式人工智能服务管理暂行办法》等多项规章,对人工智能相关技术规范、义务主体与责任作出规定,强调技术开发、服务提供者的主体责任。

人工智能的监管工作正在迈开脚步。哈蒙德表示,他个人认为欧盟的做法很不错,他们并未过多考虑技术,而是更多地考虑风险,建立风险的等级机制。在高风险情况下,会对算法、数据和使用提出更多要求。

眼下监管也只触及皮毛。比蒂补充道,监管总是落后于技术,监管需要对技术作出有意义的平衡,确保技术被用于善而不是恶。他正在第一线接触监管立法工作,比蒂参加了科罗拉多州的一个立法特别工作组,“我们所能做的是尽最大努力制定一套合理的法规。与此同时,教育民众,让他们知道这项技术的能力,即便它还没有受到全面监管。”

需要强调的是,不仅需要对人工智能可能产生的风险进行监管,人工智能训练迭代本身也需要进一步规范。例如,生成式人工智能除了让OpenAI名声大噪外,也给该公司带来了不少的法律诉讼。

截至目前,对OpenAI提出侵犯版权诉讼的原告包括美国作家协会、《纽约时报》以及数名作家和普利策奖得主,他们声称,在未经授权的情况下,OpenAI擅自使用他们的作品训练大语言模型。

知识版权之争突出了人工智能和内容创作者间的权益边界问题。王祚曾专门研究过人工智能绘画涉及的版权问题。“可能在大家没有意识到自己的数据会被喂给人工智能的情况下,已经被盗用了。”

他进一步解释称,机器学习能力远超过人类,如果人工智能学习某一位创作者的设计风格,对其进行复制或微调,都会对创作者权益造成损害。目前有关数据所有权的意识正在逐步建立,有些网站会新增条款,明确标注“No AI”,去保护创作者的权益。

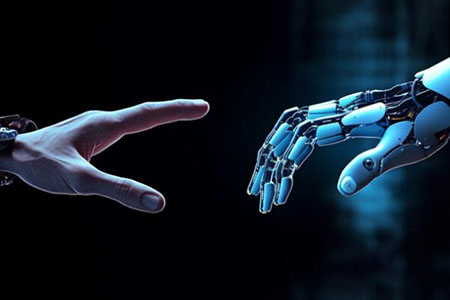

随着人工智能不断发展,许多业界专家将目光放得更远,不仅看到人工智能可能会侵犯人类权益,也开始警惕其对人类文明的冲击。罗素曾警告称,若没有相应的规划和管理,人类可能失去对人工智能的控制,产生“文明终结”级别的严重后果。

谈及未来人类与人工智能间的关系,哈蒙德则显得乐观许多,他将构建人工智能想象成抚养一个孩子,大家当然希望孩子比自己更聪明、更成功,同时不要伤害别人,“应该思考的是如何让人工智能与人类保持一致,我无法想象人工智能会在人类没有设定的情况下,试图消灭一切工作或要接管一切,我们应计划的是未来人类与人工智能间的伙伴关系。”